Voici quelques informations, un peu plus sensibles sur la gestion des mots de passe.

1) Mot de passe SST

Pour accéder aux outils de maintenance système (SST), vous devez avoir un profil créé (CRTSSTUSR) et votre profil IBMi devra avoir le droit *SERVICE

vous pouvez ensuite lancer une session SST par STRSST

2) Mot de passe iNetServer

iNetServer gère son propre contrôle de mot de passe identique pour accéder à vos partages.

vous avez sans doute déjà reçu des messages CPIB682 qui indiquent que l’utilisateur est désactivé pour NetServer

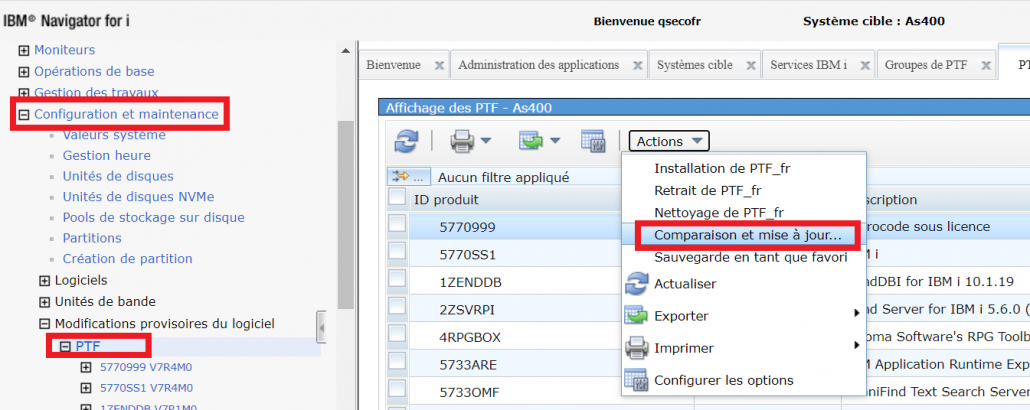

pour le réactiver vous pouvez passer par Navigator For i ou utiliser l’API QZLSCHSI

exemple ici

https://www.ibm.com/support/pages/node/684479

3) Contrôler un mot de passe

Par la commande CHKPWD sur le profil en cours , monmsg CPF2300 à traiter

Par API QSYGETPH, plus d’information, sur le site https://www.ibm.com/support/knowledgecenter/ssw_ibm_i_74/apis/QSYGETPH.htm

exemple

PGM PARM(&userid &passwrd &STS)

/* Paramètres*/

DCL VAR(&USERID) TYPE(CHAR) LEN(10) /* input */

DCL VAR(&PASSWRD) TYPE(CHAR) LEN(10) /* input */

DCL &STS *CHAR 01 /* output */

/* Variables de travail / DCL VAR(&ERRORCODE) TYPE(CHAR) LEN(272)

DCL VAR(&MSGID) TYPE(CHAR) STG(DEFINED) LEN(7) DEFVAR(&ERRORCODE 9)

DCL VAR(&HANDLE) TYPE(CHAR) LEN(12)

/* Récupère le handle */

CHGVAR VAR(&ERRORCODE) VALUE(X’0110′) CALL QSYGETPH (&USERID &PASSWRD &HANDLE &ERRORCODE X’0000000A’ X’FFFFFFFF’) /* test message d’erreur */

If (&MSGID *ne ‘ ‘) THEN(Do)

CHGVAR VAR(&STS) VALUE(‘1’)

SNDPGMMSG MSGID(CPF9897) MSGF(*LIBL/QCPFMSG) +

MSGDTA(&MSGID *BCAT ‘Erreur contrôle de +

mot de passe’) MSGTYPE(ESCAPE) ENDDO ELSE CMD(DO) CHGVAR &STS VALUE(‘0’) SNDPGMMSG MSGID(CPF9897) MSGF(LIBL/QCPFMSG) +

MSGDTA(‘Mot de passe correct pour le +

profil ‘ !! &USERID) MSGTYPE(*COMP)

ENDDO

ENDPGM

4) Supprimer le mot de passe

Certains utilisateurs ne servent pas à se connecter et il peut être important de leurs enlever celui c’est le cas des profils de QSRV et QSRVBAS par exemple !

pour réaliser cette opération vous devez faire un chgusrprf en indiquant le paramètre PASSWORD(*NONE)

5) Rendre un mot de passe utilisateur sans être *SECADM

Par défaut un utilisateur ne peut modifier que son mot de passe. Pour qu’un utilisateur puisse rendre un mot de passe, on peut faire un programme en adoption de droit par rapport à un profil qui lui a *SECADM.

exemple

commande

CMD PROMPT(‘Changement PWD Utilisateur’)

PARM KWD(USRPRF) TYPE(NAME) LEN(10) MIN(1) + PROMPT(‘Profil utilisateur’)

programme

PGM PARM(&USR)

DCLPRCOPT USRPRF(OWNER)

/* paramètres */

dcl &usr *char 10

/* variables de travail */

dcl &usre *char 10

CHKOBJ OBJ(&USR) OBJTYPE(*USRPRF)

monmsg cpf9801 exec(do)

SNDUSRMSG MSG(‘Profil,’ *BCAT &USR BCAT ‘inexistant’) + MSGTYPE(INFO)

RETURN

enddo

RTVJOBA USER(&USrE)

CHGUSRPRF USRPRF(&USR ) PASSWORD(&USR ) +

PWDEXP(YES) STATUS(ENABLED)

monmsg cpf0000 exec(do)

SNDMSG MSG(‘Modification de passe impossible pour +

l »utilisateur’ *BCAT &USR *BCAT ‘demandée +

par’ BCAT &USRE) TOMSGQ(HSTLOG)

RETURN

enddo

SNDMSG MSG(‘Mot de passe pour l »utilisateur’ *BCAT +

&USR *BCAT ‘réinitialisé par’ BCAT + &USRE) TOMSGQ(HSTLOG)

endpgm